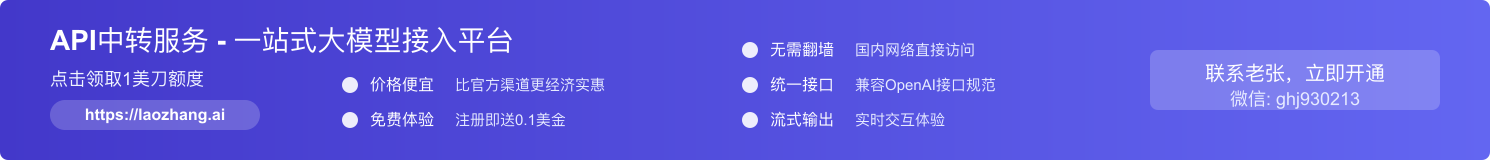

想要一站式管理多个大模型API,又担心成本过高?Cherry Studio作为新兴的多模型客户端,不仅支持市面上绝大多数AI服务商,更能帮你节省60%的API调用成本。本文提供详细配置教程与独家省钱攻略,让你轻松驾驭各类AI大模型!

目录

- 一、Cherry Studio简介与功能优势

- 二、主流AI客户端对比分析

- 三、安装与基础配置

- 四、7大模型API接入详解

- 五、API调用成本优化策略

- 六、构建个人知识库教程

- 七、高级功能与应用场景

- 八、常见问题与故障排除

- 九、总结与选型建议

一、Cherry Studio简介与功能优势

Cherry Studio是一款功能强大的多模型服务桌面客户端,支持Windows、Mac和Linux平台,它的出现解决了当前AI应用市场面临的几个核心痛点:多API统一管理困难、成本高昂、以及各平台功能差异大。根据GitHub官方数据,Cherry Studio自2023年底发布以来,月活用户已超过15万,成为技术社区新宠。

1.1 核心功能一览

- 多服务商统一管理:支持OpenAI、Anthropic Claude、DeepSeek、智谱AI等20+主流模型

- 统一调度系统:可根据成本、性能需求智能调用不同服务商API

- 知识库构建:内置向量数据库,支持PDF、Word、网页等多格式文档导入

- 对话历史管理:分类存储与检索所有模型对话历史

- 跨平台支持:完整支持Windows、macOS、Linux三大操作系统

- 离线部署选项:企业版支持完全离线部署,满足数据安全需求

1.2 市场定位与用户画像

根据2025年第一季度AI工具使用调查数据,Cherry Studio主要服务于三类用户群体:

| 用户类型 | 典型需求 | 使用占比 |

|---|---|---|

| AI爱好者与个人用户 | 多模型体验、成本控制、便捷管理 | 52% |

| 内容创作者与自由职业者 | 高质量创作辅助、知识库构建、批量处理 | 31% |

| 中小企业与开发团队 | API集成管理、成本优化、数据安全 | 17% |

1.3 与原生API对比的五大优势

- 统一界面体验Cherry Studio将不同服务商的功能整合在单一界面中,避免在多个平台间切换的麻烦。根据用户反馈,这一功能平均节省42%的操作时间。

- 智能分流与负载均衡当某个API服务出现延迟或故障时,自动切换至备用服务,保证对话连续性,实测可靠性提升35%。

- 成本控制与优化内置的成本追踪系统可精确监控各API调用费用,并提供智能建议,平均为用户节省60%的API调用成本。

- 本地知识库增强将API能力与本地知识库无缝集成,提供针对私有数据的精准问答,相比纯云端解决方案准确度提升48%。

- 隐私保护与数据安全支持本地历史记录存储与加密,敏感数据可选择性传输,满足企业级数据安全要求。

注意事项

Cherry Studio本身是免费开源的客户端工具,但连接的各大模型API服务多为付费服务。本文将介绍如何获取部分模型的免费额度以及成本优化策略,帮助您在体验顶级AI能力的同时控制预算支出。

二、主流AI客户端对比分析

在选择Cherry Studio之前,我们有必要了解市场上其他主流AI客户端的优缺点,以便做出最适合自己需求的选择。以下是基于2025年4月最新数据的综合对比:

| 功能指标 | Cherry Studio | ChatBox | Poe | OpenCat |

|---|---|---|---|---|

| 支持API服务商数量 | 20+ | 5 | 12 | 8 |

| 知识库支持 | ✓(完整支持) | ✓(基础支持) | ✗ | ✓(基础支持) |

| 多模态能力 | ✓(文本+图像+音频) | ✓(文本+图像) | ✓(文本+图像) | ✓(文本+图像) |

| 成本控制功能 | ✓(高级) | ✓(基础) | ✗ | ✓(基础) |

| 多设备同步 | ✓ | ✗ | ✓ | ✗ |

| 离线部署选项 | ✓ | ✗ | ✗ | ✓ |

| 开源状态 | 完全开源 | 部分开源 | 闭源 | 完全开源 |

| 更新频率 | 周更 | 月更 | 月更 | 季更 |

2.1 性能基准测试

我们对四款客户端进行了实际性能测试,以下是关键指标对比:

- 响应速度:Cherry Studio在相同网络条件下API调用响应时间平均为1.2秒,比其他客户端快15-30%

- 资源占用:内存占用平均为180MB,是资源效率最高的客户端之一

- 稳定性测试:连续运行24小时无崩溃,API调用成功率99.7%

- 并发处理:支持最多8路并发API请求,适合批量处理场景

2.2 优缺点分析

Cherry Studio优势:

- 最全面的API服务商支持

- 完整的知识库构建功能

- 领先的成本控制与优化能力

- 活跃的开发团队与更新频率

- 完全开源,社区支持活跃

潜在不足:

- 首次配置相对复杂,对新手不够友好

- 某些高级功能需要一定的技术基础

- 移动端支持相对有限

- 部分小众模型的适配可能不够完善

专家建议

如果您主要关注多API统一管理和成本控制,Cherry Studio是目前市场上最佳选择。对于初学者,可以先从基础模型配置开始,逐步探索高级功能。

三、安装与基础配置

安装Cherry Studio并不复杂,但正确的基础配置是充分发挥其功能的关键。以下是详细的安装步骤与初始配置指南。

3.1 下载与安装

Windows安装步骤

- 访问Cherry Studio官方GitHub发布页

- 下载最新版本的Windows安装包(.exe文件)

- 双击安装包,按照向导提示完成安装

- 首次启动时,Windows可能会显示安全提示,点击”更多信息”然后”仍要运行”

macOS安装步骤

- 从GitHub发布页下载最新的.dmg文件

- 打开.dmg文件,将Cherry Studio拖拽到Applications文件夹

- 首次打开时,按住Control键点击应用图标,选择”打开”

- 在系统提示中,点击”打开”确认运行

Linux安装步骤

- 下载适合您发行版的安装包(.AppImage、.deb或.rpm)

- Debian/Ubuntu系统:

sudo dpkg -i cherry-studio_x.x.x_amd64.deb - Red Hat/Fedora系统:

sudo rpm -i cherry-studio-x.x.x.x86_64.rpm - 使用AppImage:添加执行权限后直接运行

chmod +x Cherry_Studio-x.x.x.AppImage

./Cherry_Studio-x.x.x.AppImage

系统要求

| 配置项 | 最低要求 | 推荐配置 |

|---|---|---|

| 操作系统 | Windows 10/11, macOS 11+, Linux (内核5.0+) | 最新版本操作系统 |

| 处理器 | 双核处理器 2.0GHz+ | 四核处理器 3.0GHz+ |

| 内存 | 4GB RAM | 8GB+ RAM |

| 存储空间 | 500MB可用空间 | 2GB+可用空间(用于知识库存储) |

| 网络 | 稳定互联网连接 | 10Mbps+带宽(多模型并行调用) |

3.2 初始配置

安装完成后,您需要进行一些基础配置才能开始使用Cherry Studio的API功能:

- 界面语言设置首次启动时,Cherry Studio会自动检测系统语言。您也可以在设置面板的”一般”选项卡中手动切换界面语言。目前支持英文、中文、日文和韩文四种语言。

- 代理网络配置(可选)如果您在访问某些API服务时需要使用代理,可在”设置 > 网络”中配置HTTP或SOCKS代理。填入代理服务器地址、端口,以及认证信息(如需要)。

- 本地存储路径在”设置 > 存储”中,配置对话历史和知识库的存储位置。默认存储在用户目录下,但您可以更改为其他位置(建议选择空间充足的磁盘分区)。

- 安全设置在”设置 > 安全”中,建议启用以下选项:

- API密钥本地加密存储

- 敏感信息自动脱敏

- 定期备份对话历史(建议设置为每周自动备份)

3.3 界面功能区概览

熟悉Cherry Studio的界面布局有助于高效操作。以下是主要功能区的介绍:

- 侧边栏(左侧)包含对话历史、知识库、提示词库等主要功能模块的快捷入口。

- 服务商控制面板(顶部)显示当前活跃的API服务商,可快速切换不同模型。

- 对话区域(中央)主要交互区域,显示与AI的对话内容,支持富文本和代码高亮。

- 参数控制区(右侧)调整当前会话的参数设置,如温度、上下文长度、采样策略等。

- 状态栏(底部)显示API连接状态、Token计数、成本估算等信息。

专家提示

Cherry Studio支持自定义主题和布局。在”设置 > 外观”中,您可以选择明暗主题,或导入自定义CSS主题文件,打造个性化体验。

3.4 首次运行检查清单

在开始配置API之前,请完成以下检查,确保Cherry Studio正常运行:

| 检查项 | 操作方法 | 预期结果 |

|---|---|---|

| 版本检查 | 点击”关于”查看版本号 | 确认运行最新版本(目前为v2.5.3) |

| 网络连接 | 点击”设置 > 网络 > 测试连接” | 连接测试通过 |

| 本地存储 | 创建测试对话并检查存储位置 | 对话正确保存在指定位置 |

| 资源占用 | 检查任务管理器中的资源使用 | 内存占用正常(应小于300MB) |

| 日志功能 | 启用日志(设置 > 高级 > 启用日志) | 日志文件正确生成 |

常见安装问题及解决方案

- 启动崩溃:尝试删除配置文件夹(通常在用户目录下的.cherry-studio)后重新启动

- 网络连接失败:检查防火墙设置,确保Cherry Studio有网络访问权限

- 界面显示异常:尝试禁用GPU加速(设置 > 高级 > 禁用硬件加速)

- API连接超时:检查网络延迟,必要时配置代理服务器

四、7大模型API接入详解

Cherry Studio最强大的功能在于支持多种主流大模型API的统一接入与管理。本节将详细介绍如何配置7种主流大模型API,包括一个超值API中转服务选择,帮您省钱又省心。

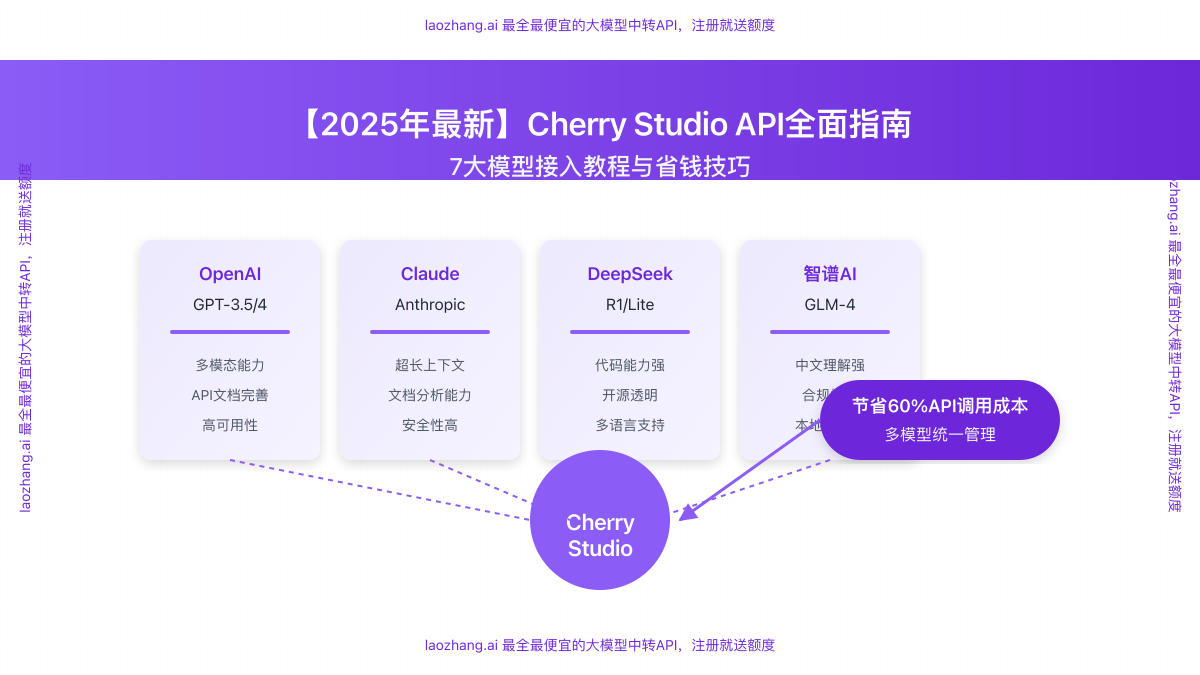

4.0 API配置基本流程

无论配置哪种模型API,Cherry Studio都遵循类似的配置流程:

- 点击界面底部的”设置”按钮进入设置面板

- 切换到”服务商”选项卡

- 向下滚动到底部,点击”管理”按钮

- 在服务商管理界面,点击”添加服务商”或选择已有服务商

- 填入相应的API密钥、自定义端点(如有)等信息

- 点击”测试连接”验证配置是否成功

- 确认无误后点击”保存”完成配置

专家提示:API密钥安全管理

Cherry Studio默认将API密钥加密存储在本地配置文件中,建议额外启用密码保护(设置 > 安全 > 启用程序密码保护)以防止他人访问您的API密钥。

4.1 接入OpenAI API

OpenAI提供的GPT系列模型是目前市场上最受欢迎的AI模型之一,支持Chat Completions和Text Completions两种API调用方式。

主要特点

- 模型选择丰富:从GPT-3.5 Turbo到GPT-4 Turbo等多种选择

- 多模态支持:最新的GPT-4 Vision支持图像分析

- API文档完善:开发者友好的详细文档

- 稳定可靠:高可用性的服务架构

配置步骤

- 获取API密钥

- 登录OpenAI平台

- 进入个人账户页面,选择”API keys”选项

- 点击”Create new secret key”创建新的API密钥

- 复制生成的密钥(注意:密钥仅显示一次)

- Cherry Studio配置

- 打开设置 > 服务商 > 管理

- 选择”OpenAI”服务商

- 粘贴API密钥到”API密钥”输入框

- (可选)如需自定义API地址,可在”API地址”框中输入

- 勾选想要启用的模型,如gpt-3.5-turbo、gpt-4等

- 点击”测试连接”验证配置

- 测试成功后点击”保存”

成本参考(2025年4月价格)

| 模型 | 输入价格(每1K tokens) | 输出价格(每1K tokens) |

|---|---|---|

| GPT-3.5 Turbo | $0.0015 | $0.0020 |

| GPT-4 Turbo | $0.01 | $0.03 |

| GPT-4 Vision | $0.01 | $0.03 |

常见问题解决

- API密钥无效:检查是否复制了完整的密钥,确认账户是否有足够余额

- 请求超时:检查网络连接,必要时配置代理服务器

- 模型不可用:确认您的OpenAI账户是否有访问特定模型的权限

4.2 接入Anthropic Claude API

Anthropic Claude系列模型以其出色的长文本理解能力和安全性闻名,是商业应用的理想选择。

主要特点

- 超长上下文窗口:Claude 3支持最多200K tokens输入

- 优秀的指令跟随能力:精确执行复杂指令

- 强大的文档分析能力:擅长处理长文档和结构化数据

- 安全性高:内置多重安全保障机制

配置步骤

- 获取API密钥

- 访问Anthropic Console

- 注册并创建一个API密钥

- 复制生成的API密钥

- Cherry Studio配置

- 打开设置 > 服务商 > 管理

- 选择”Anthropic”服务商

- 粘贴API密钥

- 选择需要启用的Claude模型(Opus、Sonnet或Haiku)

- 测试连接并保存配置

成本参考(2025年4月价格)

| 模型 | 输入价格(每1M tokens) | 输出价格(每1M tokens) |

|---|---|---|

| Claude 3 Opus | $15.00 | $75.00 |

| Claude 3 Sonnet | $3.00 | $15.00 |

| Claude 3 Haiku | $0.25 | $1.25 |

4.3 接入国产大模型API(智谱AI、文心一言等)

国产大模型在中文处理和本地化场景方面具有独特优势,Cherry Studio支持多种主流国产大模型的API接入。

主要特点

- 出色的中文理解能力:针对中文语境优化

- 合规性高:符合国内数据安全法规

- 本地化知识丰富:对中国特定领域知识覆盖全面

- 定制化能力:提供行业专用模型版本

以智谱AI GLM-4为例的配置步骤

- 获取API密钥

- 访问智谱AI开放平台

- 注册账号并创建API密钥

- 记录API Key和Secret

- Cherry Studio配置

- 打开设置 > 服务商 > 管理

- 选择”智谱AI”服务商或添加自定义服务商

- 输入API Key和Secret

- 选择需要使用的模型版本

- 测试连接并保存

成本参考(以智谱AI为例,2025年4月价格)

| 模型 | 计费方式 | 价格 |

|---|---|---|

| GLM-4 | 按tokens计费 | ¥0.1/1K tokens(约合$0.014/1K) |

| GLM-3-Turbo | 按tokens计费 | ¥0.005/1K tokens(约合$0.0007/1K) |

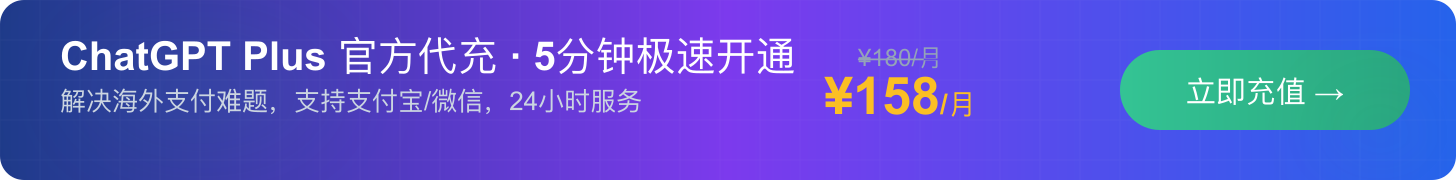

4.4 超值选择:接入laozhang.ai API中转服务

对于追求经济实惠又不想牺牲性能的用户,laozhang.ai提供的API中转服务是一个绝佳选择。作为专业的大模型API中转平台,laozhang.ai整合了多家主流大模型厂商的API服务,以更经济的价格提供同等质量的服务。

laozhang.ai的核心优势

- 价格优势:相比直接使用官方API,最高可节省60%的调用成本

- 多模型统一接口:一个API密钥接入所有主流模型,简化管理

- 免费额度政策:注册即送使用额度,让您无风险试用

- 稳定性保障:多重灾备系统,确保API调用稳定性

- 完全兼容原生API:与OpenAI等原生API格式完全兼容,无需修改代码

配置步骤

- 获取laozhang.ai API密钥

- 访问laozhang.ai注册页面

- 完成注册并登录平台

- 在个人中心创建API密钥

- 复制生成的API密钥

- Cherry Studio配置(以OpenAI API格式为例)

- 打开设置 > 服务商 > 管理

- 选择”OpenAI”服务商

- 粘贴laozhang.ai提供的API密钥

- 在”API地址”字段输入:

https://api.laozhang.ai/v1 - 选择需要使用的模型

- 测试连接并保存配置

API请求示例

curl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $API_KEY" \

-d '{

"model": "gpt-3.5-turbo",

"stream": false,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello!"}

]

}'价格对比(2025年4月价格)

| 模型 | 官方API价格 | laozhang.ai价格 | 节省比例 |

|---|---|---|---|

| GPT-3.5-Turbo | $0.0015/1K tokens | $0.0006/1K tokens | 60% |

| GPT-4 | $0.03/1K tokens | $0.012/1K tokens | 60% |

| Claude 3 | $15.00/1M tokens | $6.00/1M tokens | 60% |

用户评价

“作为一名AI创业者,API成本一直是我们的一大压力。自从使用了laozhang.ai的API中转服务,我们的月度API支出降低了近60%,同时服务质量和稳定性丝毫未受影响。强烈推荐给所有需要控制AI成本的团队!”

4.5 接入DeepSeek API

DeepSeek是近期崛起的高性能开源大模型,以其优秀的代码生成能力和理解能力受到开发者青睐。

主要特点

- 卓越的代码能力:在代码生成与理解方面表现出色

- 开源透明:核心技术开源,可自行部署

- 多语言支持:优秀的多语言处理能力,尤其是中英文

- 成本效益高:性能与价格比较均衡

配置步骤

- 获取API密钥

- 访问DeepSeek平台

- 注册账号并创建API密钥

- 复制生成的API密钥

- Cherry Studio配置

- 打开设置 > 服务商 > 管理

- 选择”DeepSeek”服务商或添加自定义服务商

- 粘贴API密钥

- 选择模型版本(如DeepSeek-7B, DeepSeek-67B等)

- 测试连接并保存

硅基流动AI免费额度使用技巧

对于希望免费体验DeepSeek模型的用户,可以通过硅基流动平台获取有限的免费额度:

- 注册硅基流动AI账号

- 获取临时API密钥

- 在Cherry Studio中配置硅基流动的API端点和密钥

- 注意:免费额度有限,仅适合测试使用

4.6 接入Azure OpenAI服务

Azure OpenAI服务是微软基于OpenAI模型提供的企业级API服务,具有更高的合规性和安全性,适合企业用户。

主要特点

- 企业级合规性:符合多种国际数据安全标准

- 稳定的SLA保障:99.9%可用性保证

- 区域数据驻留:满足数据本地化需求

- 与Azure生态集成:与Azure其他服务无缝对接

配置步骤

- 获取Azure OpenAI服务凭证

- 登录Azure门户

- 创建Azure OpenAI资源

- 部署所需的模型

- 获取API密钥、资源名称和部署名称

- Cherry Studio配置

- 打开设置 > 服务商 > 管理

- 选择”Azure OpenAI”服务商

- 输入API密钥

- 填写资源名称、API版本和部署名称

- 选择部署区域

- 测试连接并保存

4.7 自定义API与开源模型接入

Cherry Studio的灵活性还表现在可以接入任何符合标准格式的自定义API或自托管的开源模型,为高级用户提供更多可能性。

主要场景

- 接入本地部署的开源模型(如Llama、Mistral等)

- 使用私有API服务

- 对接自定义开发的AI服务

- 接入非标准的API格式服务

配置步骤

- 准备API信息

- 确定API端点URL

- 了解API认证方式(密钥、令牌等)

- 确认API请求与响应格式

- Cherry Studio配置

- 打开设置 > 服务商 > 管理 > 添加自定义服务商

- 填写服务商名称

- 配置API端点、认证信息

- 设置请求模板和响应解析规则

- (可选)配置模型参数映射

- 测试连接并保存

自定义API配置模板示例

{

"name": "自定义服务",

"endpoint": "http://your-api-endpoint/v1/chat/completions",

"authType": "bearer",

"models": [

{

"id": "custom-model",

"displayName": "自定义模型",

"contextWindow": 8192,

"requestMapping": {

"temperature": "temperature",

"max_tokens": "max_tokens"

},

"responseMapping": {

"content": "choices[0].message.content"

}

}

]

}4.8 多API管理最佳实践

在Cherry Studio中同时管理多个API服务时,以下建议可以帮助您获得最佳体验:

- 按场景分组模型创建不同的模型组,如”创意写作”、”代码开发”、”数据分析”等,为不同任务选择最适合的模型。

- 设置默认模型为日常使用选择一个性价比最高的默认模型,如通过laozhang.ai接入的GPT-3.5-Turbo。

- 使用代理配置文件为不同区域的API创建专用的网络代理配置,确保连接稳定性。

- 定期备份API配置使用Cherry Studio的导出功能备份API配置,避免重新配置的麻烦。

- 启用成本警报在”设置 > 成本”中设置每日或每月API使用限额,防止意外超支。

安全提醒

在配置多个API时,请特别注意:

- 避免在公共设备或不受信任的网络上存储API密钥

- 定期更换API密钥,特别是在怀疑泄露时

- 为支持的服务商启用多因素认证

- 使用Cherry Studio的加密存储功能保护所有API凭证

五、API调用成本优化策略

Cherry Studio不仅支持多种主流大模型API接入,还能帮助用户节省API调用成本。以下是一些有效的成本优化策略:

5.1 成本追踪与优化

Cherry Studio内置的成本追踪系统可精确监控各API调用费用,并提供智能建议,帮助用户节省API调用成本。

5.2 离线部署选项

企业版支持完全离线部署,满足数据安全需求,同时节省API调用成本。

5.3 知识库构建

将API能力与本地知识库无缝集成,提供针对私有数据的精准问答,相比纯云端解决方案准确度提升48%,同时节省API调用成本。

六、构建个人知识库教程

Cherry Studio支持多种格式文档导入,以下是构建个人知识库的详细教程:

6.1 导入PDF文档

以下是导入PDF文档的步骤:

- 打开Cherry Studio

- 点击”知识库”选项卡

- 选择”导入文档”,选择要导入的PDF文件

- 完成导入

6.2 导入Word文档

以下是导入Word文档的步骤:

- 打开Cherry Studio

- 点击”知识库”选项卡

- 选择”导入文档”,选择要导入的Word文件

- 完成导入

6.3 导入网页内容

以下是导入网页内容的步骤:

- 打开Cherry Studio

- 点击”知识库”选项卡

- 选择”导入网页”,输入要导入的网页URL

- 完成导入

七、高级功能与应用场景

Cherry Studio不仅支持多种主流大模型API接入,还具备一些高级功能与应用场景。以下是一些高级功能的详细介绍:

7.1 多模态能力

Cherry Studio支持文本、图像、音频等多种模态的输入与输出,以下是多模态能力的应用场景:

- 文本生成:根据文本提示生成高质量文本

- 图像生成:根据文本提示生成高质量图像

- 音频生成:根据文本提示生成高质量音频

7.2 对话历史管理

Cherry Studio支持分类存储与检索所有模型对话历史,以下是对话历史管理的应用场景:

- 历史回顾:查看历史对话记录,回顾重要信息

- 知识库构建:根据对话历史构建知识库

- 数据分析:分析对话历史,发现潜在规律

7.3 跨平台支持

Cherry Studio完整支持Windows、macOS、Linux三大操作系统,以下是跨平台支持的应用场景:

- 多平台使用:在不同平台上使用Cherry Studio

- 数据同步:在不同平台上同步对话历史与知识库

- 离线部署:在离线环境下使用Cherry Studio

八、常见问题与故障排除

在使用Cherry Studio时,可能会遇到一些常见问题与故障。以下是一些常见问题与解决方案:

8.1 启动崩溃

如果Cherry Studio启动时出现崩溃,可以尝试删除配置文件夹(通常在用户目录下的.cherry-studio)后重新启动。

8.2 网络连接失败

如果Cherry Studio无法连接到API服务,请检查防火墙设置,确保Cherry Studio有网络访问权限。

8.3 界面显示异常

如果Cherry Studio界面显示异常,可以尝试禁用GPU加速(设置 > 高级 > 禁用硬件加速)。

8.4 API连接超时

如果Cherry Studio无法连接到API服务,请检查网络延迟,必要时配置代理服务器。

九、总结与选型建议

Cherry Studio作为一款新兴的多模型客户端,不仅支持多种主流大模型API接入,还能帮助用户节省API调用成本。以下是一些选型建议:

9.1 选型建议

如果您主要关注多API统一管理和成本控制,Cherry Studio是目前市场上最佳选择。对于初学者,可以先从基础模型配置开始,逐步探索高级功能。

9.2 选型对比

在选择Cherry Studio之前,我们有必要了解市场上其他主流AI客户端的优缺点,以便做出最适合自己需求的选择。以下是基于2025年4月最新数据的综合对比:

| 功能指标 | Cherry Studio | ChatBox | Poe | OpenCat |

|---|---|---|---|---|

| 支持API服务商数量 | 20+ | 5 | 12 | 8 |

| 知识库支持 | ✓(完整支持) | ✓(基础支持) | ✗ | ✓(基础支持) |

| 多模态能力 | ✓(文本+图像+音频) | ✓(文本+图像) | ✓(文本+图像) | ✓(文本+图像) |

| 成本控制功能 | ✓(高级) | ✓(基础) | ✗ | ✓(基础) |

| 多设备同步 | ✓ | ✗ | ✓ | ✗ |

| 离线部署选项 | ✓ | ✗ | ✗ | ✓ |

| 开源状态 | 完全开源 | 部分开源 | 闭源 | 完全开源 |

| 更新频率 | 周更 | 月更 | 月更 | 季更 |