随着AI技术的迅猛发展,Google的Gemini系列大语言模型凭借其出色的多模态能力和强大的代码生成能力,已成为全球开发者争相使用的重要工具。然而,由于区域限制政策,中国大陆用户面临着无法直接访问Gemini API的困境。根据Google官方文档,中国大陆并不在Gemini API和Google AI Studio的支持地区列表中。

本文将为您提供2025年5月最新实测有效的三种解决方案,帮助国内开发者和企业轻松使用Gemini API,充分利用Google最先进的AI技术。无论您是个人开发者还是企业用户,都能找到适合自己的方案!

一、为什么国内无法直接使用Gemini API?

了解问题才能更好地解决问题。国内用户无法直接使用Gemini API主要有以下两大障碍:

- 区域限制政策:根据Google官方文档,Gemini API仅对特定国家和地区开放,而中国大陆不在支持名单中

- 网络访问限制:即使拥有有效的API密钥,也无法直接连接到Google的API服务器

这些限制给国内开发者带来了巨大挑战,但不用担心,本文提供的解决方案将帮助您轻松绕过这些障碍。

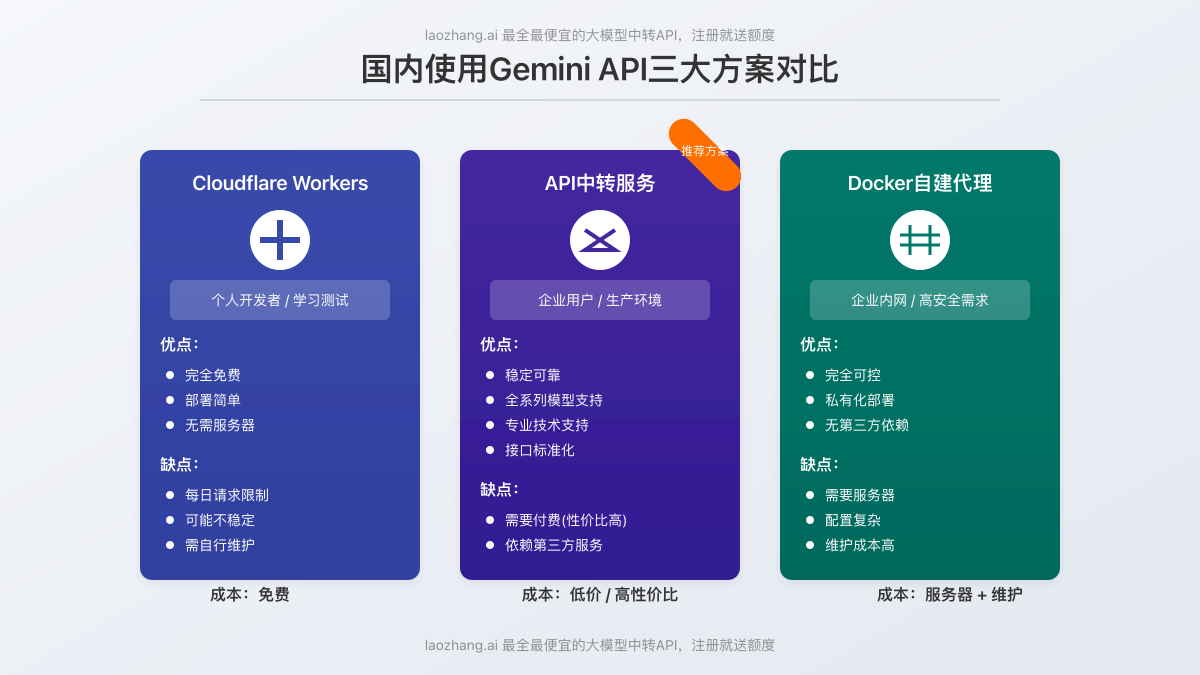

二、三大解决方案对比分析

根据不同用户的需求和技术条件,我们提供三种经过实测的解决方案,下面是它们的详细对比:

| 解决方案 | 优点 | 缺点 | 适用人群 |

|---|---|---|---|

| Cloudflare Workers反向代理 |

|

|

个人开发者、学习测试、低频使用场景 |

| API中转服务(推荐) |

|

|

企业用户、生产环境、需要稳定性的项目 |

| Docker自建代理 |

|

|

企业内网、高安全需求、技术团队支持 |

接下来,我们将详细介绍每种方案的具体实现步骤。

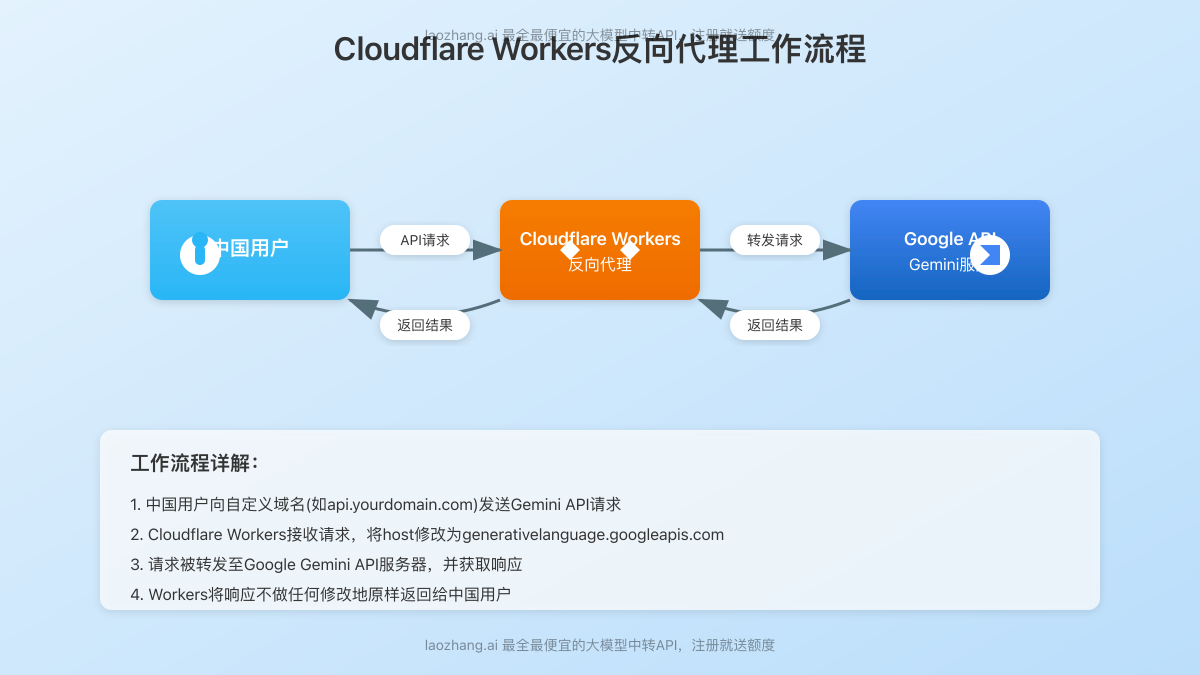

三、方案一:使用Cloudflare Workers搭建反向代理

Cloudflare Workers是一种边缘计算服务,可以在全球边缘节点上运行JavaScript代码。通过它,我们可以创建一个简单的反向代理,将请求转发到Google的Gemini API服务器。

前置条件

- 一个Cloudflare账号

- 一个已添加到Cloudflare的域名(可以使用免费的二级域名)

- 有效的Gemini API密钥(需通过非中国大陆IP申请)

1. 申请Gemini API密钥

- 使用非中国大陆IP访问Google AI Studio

- 登录Google账号并导航到API密钥页面

- 创建一个新的API密钥

- 安全保存密钥信息(密钥仅显示一次)

2. 创建Cloudflare Worker

- 登录Cloudflare Dashboard

- 在左侧导航栏选择”Workers & Pages”

- 点击”创建应用程序”

- 选择”创建Worker”

- 为你的Worker命名(例如”gemini-proxy”)

- 点击”部署”按钮

- 部署完成后,点击”编辑代码”

3. 配置Worker代码

删除Worker编辑器中的默认代码,粘贴以下代码:

export default {

async fetch(request, env) {

const url = new URL(request.url);

url.host = 'generativelanguage.googleapis.com';

// 创建新的请求对象,保留原始请求的所有信息

const newRequest = new Request(url, request);

return fetch(newRequest);

}

}

这段代码的作用是将所有请求转发到Google的Gemini API端点,同时保留原始请求的所有头信息和正文内容。

点击右上角的”保存并部署”按钮完成配置。

4. 添加自定义域

由于Cloudflare Workers的默认域名(*.workers.dev)在中国大陆可能无法访问,我们需要为Worker添加一个自定义域名:

- 在Worker详情页面,切换到”触发器”选项卡

- 点击”添加自定义域”按钮

- 输入你想要使用的域名(必须是已添加到Cloudflare的域名,例如api.yourdomain.com)

- 点击”添加”按钮

5. 测试反向代理

完成以上步骤后,现在可以通过以下URL访问Gemini API:

https://你的自定义域名/v1/models/gemini-pro:generateContent使用curl命令测试:

curl -X POST \

https://你的自定义域名/v1/models/gemini-pro:generateContent \

-H "Content-Type: application/json" \

-d '{

"contents": [

{

"parts": [

{"text": "你好,Gemini"}

]

}

],

"key": "你的API密钥"

}'

如果收到正常的JSON响应,说明反向代理已成功部署。

四、方案二:使用LaoZhang.ai API中转服务(推荐方案)

虽然Cloudflare Worker方案简单免费,但对于正式项目和生产环境来说,稳定性和可靠性是首要考虑因素。这时,专业的API中转服务成为更优选择。

LaoZhang.ai提供专业的API中转服务,不仅完美解决国内访问问题,还提供更低的价格和优质的技术支持。

为什么选择LaoZhang.ai中转服务?

- 最全模型支持 – 不仅支持Gemini全系列模型,还支持Claude、ChatGPT等多种大模型

- 最低价格保证 – 比原生API成本更低,提供最具竞争力的价格

- 国内直连 – 专为中国用户优化的网络架构,稳定可靠

- 免费试用 – 注册即送体验额度,无需信用卡

- 专业技术支持 – 提供7×24小时技术支持

- 标准化接口 – 兼容OpenAI接口格式,迁移成本极低

1. 注册并获取API密钥

- 访问LaoZhang.ai注册账号

- 完成邮箱验证

- 登录账号并导航至API密钥页面

- 创建一个新的API密钥

- 复制并保存API密钥

2. 使用示例

LaoZhang.ai的API接口与OpenAI完全兼容,只需将API地址修改为LaoZhang.ai的地址,并在模型参数中指定Gemini模型即可。

cURL示例

curl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer 你的API密钥" \

-d '{

"model": "gemini-pro",

"messages": [

{"role": "system", "content": "你是一位有用的AI助手。"},

{"role": "user", "content": "你好,给我介绍一下中国的长城。"}

]

}'

Python示例

import requests

API_KEY = "你的API密钥"

API_URL = "https://api.laozhang.ai/v1/chat/completions"

def chat_with_gemini(prompt):

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "gemini-pro",

"messages": [

{"role": "system", "content": "你是一位有用的AI助手。"},

{"role": "user", "content": prompt}

]

}

response = requests.post(API_URL, headers=headers, json=data)

return response.json()["choices"][0]["message"]["content"]

# 使用示例

result = chat_with_gemini("请给我推荐五本科幻小说及其简介。")

print(result)

JavaScript/Node.js示例

async function chatWithGemini(prompt) {

const response = await fetch('https://api.laozhang.ai/v1/chat/completions', {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': `Bearer ${API_KEY}`

},

body: JSON.stringify({

model: 'gemini-pro',

messages: [

{role: 'system', content: '你是一位有用的AI助手。'},

{role: 'user', content: prompt}

]

})

});

const data = await response.json();

return data.choices[0].message.content;

}

// 使用示例

chatWithGemini('请分析中国经济在2025年的发展趋势。')

.then(result => console.log(result))

.catch(error => console.error('Error:', error));

3. 支持的Gemini模型

通过LaoZhang.ai,你可以访问Gemini的所有主要模型,包括:

- gemini-pro:适用于文本生成任务

- gemini-pro-vision:支持图像理解的多模态模型

- gemini-1.5-pro:200万token上下文窗口的强大模型

- gemini-1.5-flash:性能与价格平衡的经济型模型

- gemini-2.0-flash:新一代功能增强型模型

- gemini-2.5-pro-preview:最新预览版旗舰模型

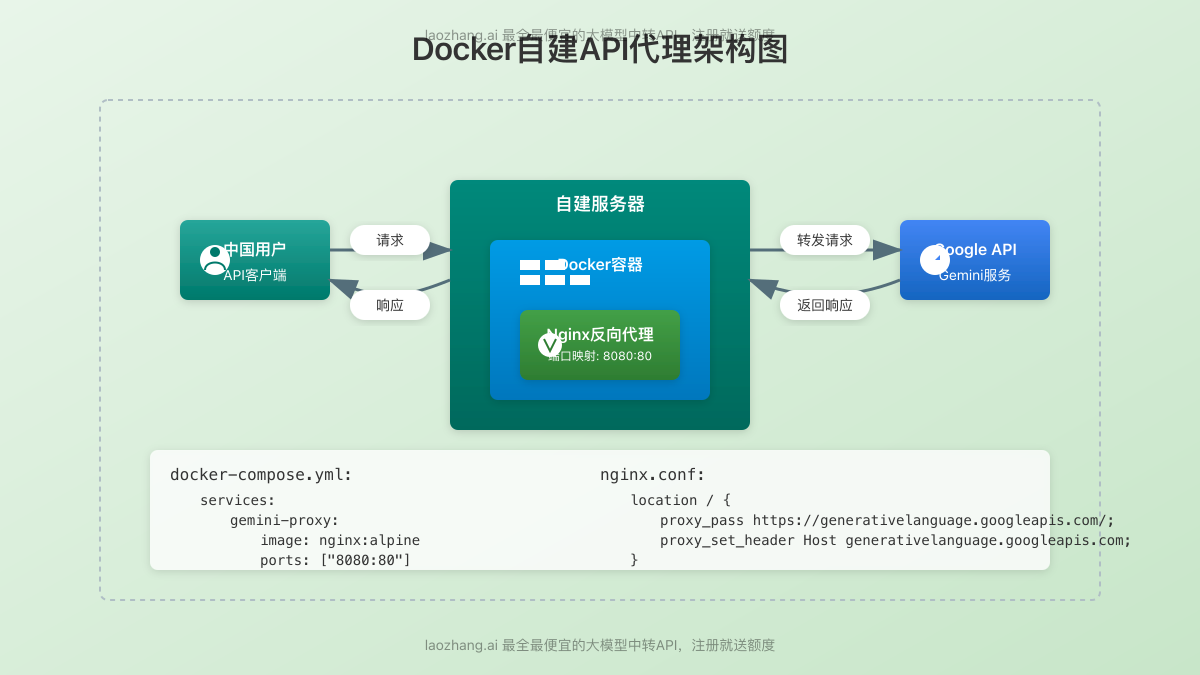

五、方案三:使用Docker部署自建API代理

对于企业用户或需要完全控制的开发者,Docker自建API代理提供了最大的灵活性和安全性,适合在私有网络中部署。

前置条件

- 一台可以访问外网的服务器(国内或国外)

- 已安装Docker和Docker Compose

- 有效的Gemini API密钥

1. 创建Docker配置文件

创建一个新的目录,并在其中创建以下文件:

docker-compose.yml:

version: '3'

services:

gemini-proxy:

image: nginx:alpine

container_name: gemini-proxy

ports:

- "8080:80"

volumes:

- ./nginx.conf:/etc/nginx/nginx.conf

restart: always

nginx.conf:

events {

worker_connections 1024;

}

http {

server {

listen 80;

location / {

proxy_pass https://generativelanguage.googleapis.com/;

proxy_ssl_server_name on;

proxy_set_header Host generativelanguage.googleapis.com;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

proxy_connect_timeout 10s;

proxy_read_timeout 60s;

proxy_send_timeout 60s;

proxy_buffering off;

}

}

}

2. 启动Docker容器

在创建的目录中执行以下命令启动代理服务:

docker-compose up -d3. 测试代理服务

使用curl测试代理服务是否正常工作:

curl http://localhost:8080/v1/models/gemini-pro:generateContent \

-H "Content-Type: application/json" \

-d '{

"contents": [

{

"parts": [

{"text": "你好,Gemini!"}

]

}

],

"key": "你的API密钥"

}'

如果返回正常的JSON响应,说明代理服务已成功部署。

六、实际应用案例:构建中文知识问答系统

下面通过一个实际案例,展示如何使用Gemini API(通过LaoZhang.ai中转)构建一个中文知识问答系统。

1. 准备工作

安装必要的库:

pip install requests streamlit2. 创建问答系统核心代码

创建app.py文件:

import streamlit as st

import requests

import json

# 配置API信息

API_KEY = "你的LaoZhang.ai API密钥"

API_URL = "https://api.laozhang.ai/v1/chat/completions"

# 设置页面

st.set_page_config(page_title="中文知识问答系统", page_icon="🧠")

st.title("基于Gemini的中文知识问答系统")

# 初始化聊天历史

if "messages" not in st.session_state:

st.session_state.messages = []

# 显示聊天历史

for message in st.session_state.messages:

with st.chat_message(message["role"]):

st.markdown(message["content"])

# 用户输入

if prompt := st.chat_input("请输入您的问题"):

# 添加用户消息到历史

st.session_state.messages.append({"role": "user", "content": prompt})

with st.chat_message("user"):

st.markdown(prompt)

# 调用API

with st.chat_message("assistant"):

with st.spinner("思考中..."):

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "gemini-pro",

"messages": [

{"role": "system", "content": "你是一个专注于提供准确信息的中文知识助手。回答要详细、准确,并尽可能提供相关背景信息。"},

*st.session_state.messages

]

}

response = requests.post(API_URL, headers=headers, json=data)

result = response.json()["choices"][0]["message"]["content"]

# 显示回复

st.markdown(result)

# 添加助手回复到历史

st.session_state.messages.append({"role": "assistant", "content": result})

3. 运行应用

streamlit run app.py通过这个简单的应用,用户可以用中文向Gemini模型提问并获得详细回答,完全不受地区限制的影响。

七、常见问题与解答

1. Gemini API在中国大陆是否合法使用?

提供生成式AI服务在中国需要遵守《生成式人工智能服务管理暂行办法》。使用Gemini API进行开发测试是可以的,但如果要面向中国用户提供基于该API的服务,建议咨询法律专业人士,确保合规。

2. 为什么推荐LaoZhang.ai而不是直接使用Cloudflare Workers?

Cloudflare Workers虽然免费,但存在请求限制、稳定性问题和维护成本。LaoZhang.ai提供专业的中转服务,解决了这些问题,同时提供更低的价格和更好的用户体验。对于任何正式项目,稳定性和可靠性都是首要考虑因素。

3. Gemini API的价格是多少?

根据Google官方价格,不同模型的价格不同。以Gemini-Pro为例,输入每100万tokens约为1.25美元,输出每100万tokens约为10美元。而通过LaoZhang.ai中转服务,可以获得比官方更低的价格。

4. 如何处理API请求失败或超时问题?

在生产环境中使用API时,应当实现以下机制:

- 错误重试机制

- 超时控制

- 备用服务

- 请求限流

- 监控告警

LaoZhang.ai的API中转服务在设计时考虑了这些问题,提供了更高的可靠性和稳定性。

5. Gemini支持哪些语言?

Gemini支持多种语言,包括中文、英文、日文、韩文等40多种语言。具体支持的语言列表可以在官方文档中查看。

八、总结与展望

随着AI技术的快速发展,获取和使用全球领先的模型能力变得越来越重要。本文介绍的三种方案为中国开发者和企业提供了可行的Gemini API使用途径,从免费的Cloudflare Workers方案到专业的LaoZhang.ai中转服务,再到自建Docker代理,可以根据不同需求选择最适合的解决方案。

特别推荐LaoZhang.ai的API中转服务,它提供了最佳的性价比和用户体验,是大多数用户的理想选择。立即注册,获取免费体验额度,开启AI开发之旅!微信咨询:ghj930213

未来,随着国际合作的深入和技术的进步,我们有理由相信,AI技术的全球共享将变得更加便捷,为人类创造更多价值。