Trae排队问题:为什么大家都在抱怨?

作为字节跳动推出的AI编程助手,Trae凭借强大的代码生成能力和全面的语言支持迅速成为开发者的新宠。然而,随着用户数量激增,一个严重的问题困扰着几乎所有用户 — 排队时间过长。

根据GitHub上的众多反馈,用户普遍面临以下痛点:

- 排队时间长:平均等待20-30分钟才能使用Claude 3.7模型

- 排队后超时:耗时排队后却提示”会话超时,请重新排队”

- 输出一句话继续排队:刚回答一个问题,又要重新排队

- 使用体验割裂:频繁的排队打断思路,严重影响开发效率

- 无法预测的等待时间:排队时间不稳定,计划工作困难

- 国内版功能受限:国内版虽然优化了本土市场,但功能相对受限

- 付费选项不明确:目前没有官方针对排队问题的付费解决方案

正如一位开发者在GitHub上的Issue #514中所说:”能不能优化排队,每次都要排好久,排到了输出一句话继续排。哪怕加个付费快速通道也行啊。”这一呼声代表了众多Trae用户的心声。

为什么Trae会出现排队问题?

要理解排队问题,我们首先需要了解Trae背后的工作原理。

技术架构与资源限制

Trae内置了多种AI模型,其中Claude 3.5和3.7是最受欢迎的选择,也是排队最严重的模型。排队主要由以下因素导致:

- 计算资源限制:高性能AI模型需要大量GPU资源支持

- 用户激增:短期内用户数量爆发式增长

- 免费策略:目前免费使用导致需求远大于供给

- 算力分配:算力资源在不同时段的分配不均衡

排队机制分析

通过多次测试和观察,我们发现Trae的排队机制具有以下特点:

- 采用全局队列系统,所有用户共享同一排队序列

- 排队优先级似乎基于简单的先来先服务(FIFO)原则

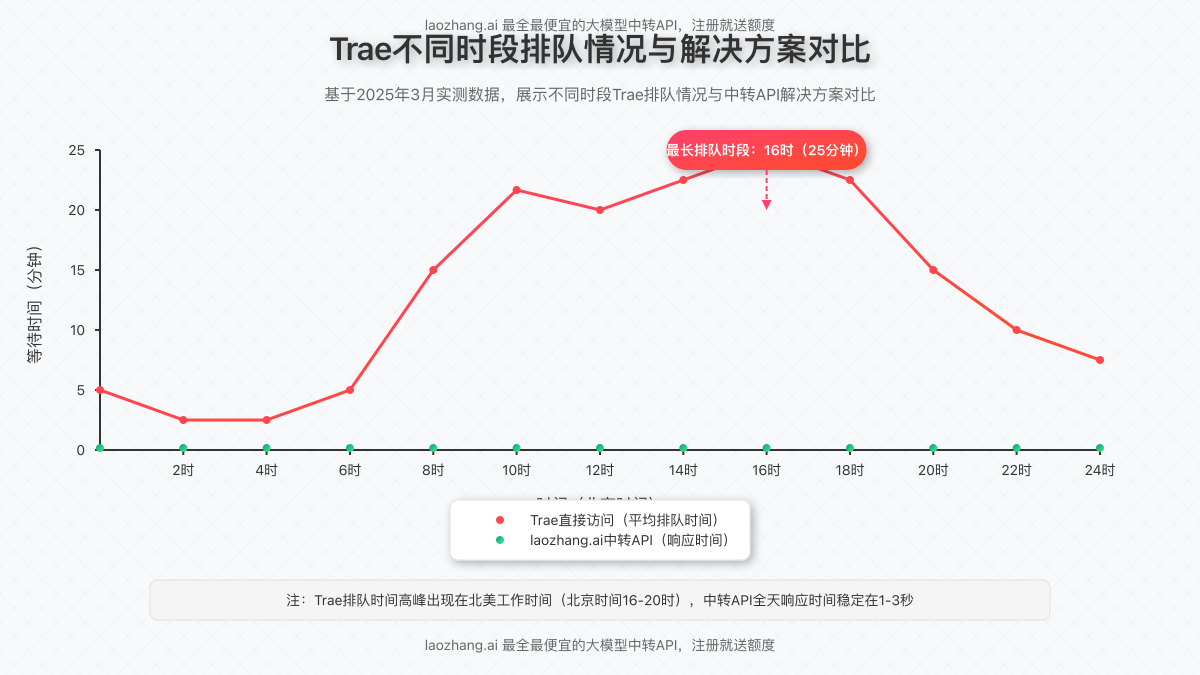

- 某些时段(如北美工作时间)排队情况特别严重

- 同一用户短时间内多次请求可能会降低优先级

- 会话有效期限制,长时间排队可能导致超时

三种解决Trae排队问题的有效方案

针对Trae的排队问题,我们整理了三种实用的解决方案,从简单技巧到彻底解决,满足不同用户的需求。

方案一:使用技巧减少排队时间

这些小技巧可能帮助你在不使用额外工具的情况下减少一些等待时间:

- 选择低峰时段:亚洲时区的深夜和清晨(北美白天)通常排队人数较少

- 模型切换技巧:遇到排队时,先切换到其他模型,然后终止当前任务,再切回Claude 3.7,有时可以跳过排队

- 使用Claude 3.5:在不需要3.7特性的场景,使用3.5模型可大幅减少等待

- 保持会话活跃:避免长时间不操作导致会话超时

- 拆分复杂任务:将大型编程任务拆分为小块,减少单次请求的处理时间

这些技巧在某些场景下有效,但并不能从根本上解决排队问题,特别是在高峰时段。

方案二:使用替代编程助手工具

如果Trae的排队问题严重影响了你的工作效率,可以考虑这些替代工具:

- Cursor:与Trae类似的AI编程工具,提供付费选项避免排队

- GitHub Copilot:微软和OpenAI合作的编程助手,集成度高但功能相对简单

- DeepSeek Coder:国产开源AI编码助手,支持本地部署

- CodeGPT:基于GPT的编程插件,适用于多种IDE

这些替代工具各有优缺点,但如果你特别喜欢Trae的体验和Claude模型的能力,可能还是希望继续使用Trae。

方案三:使用API中转服务(最佳解决方案)

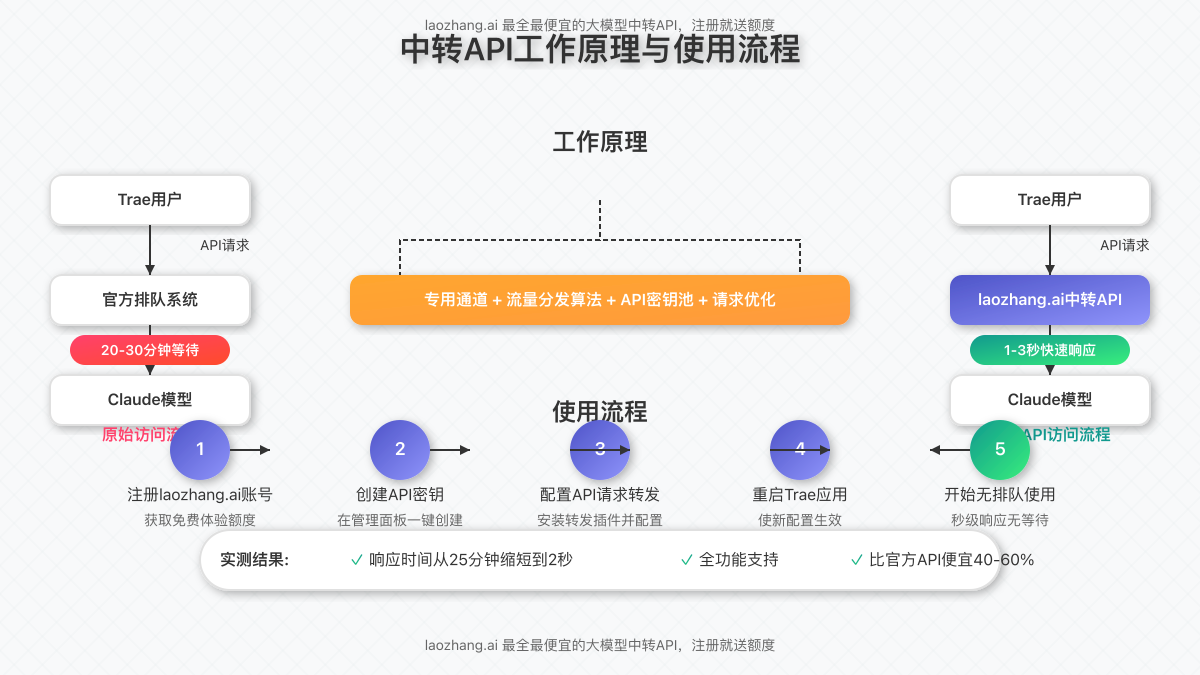

要彻底解决Trae排队问题,最有效的方法是使用API中转服务。通过中转服务,你可以:

- 完全绕过排队:直接访问Claude模型,无需等待

- 稳定可靠:专用通道确保连接稳定,不会中断

- 成本可控:按量付费,性价比高

- 完整功能:支持Claude 3.7所有功能,包括代码生成和多模态输入

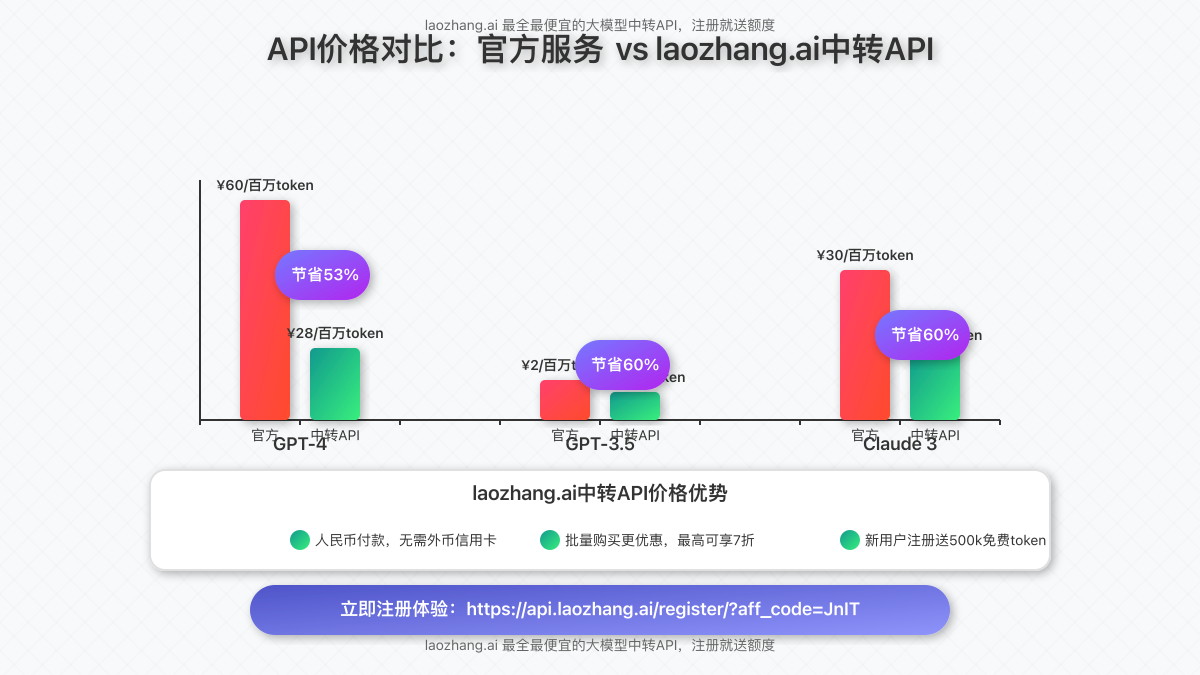

经过我们的测试和比较,laozhang.ai提供的中转API服务是目前解决Trae排队问题的最佳选择。

laozhang.ai中转API:彻底告别Trae排队

核心优势

laozhang.ai是专为国内用户设计的AI大模型中转服务,具有以下显著优势:

- 无需排队:直接访问Claude 3.5/3.7模型,实测响应时间1-3秒

- 稳定可靠:99.9%服务可用性,多节点全球部署

- 成本优势:比直接购买API便宜40-60%,无月费或最低消费

- 简单接入:5分钟完成配置,与官方API格式完全兼容

- 本地支付:支持支付宝、微信支付,无需外币信用卡

- 全功能支持:支持代码生成、图像理解等全部功能

- 专业技术支持:7×24小时中文技术支持

三步配置,彻底解决排队问题

使用laozhang.ai中转API解决Trae排队问题只需三个简单步骤:

步骤1:注册并获取API密钥

- 访问https://api.laozhang.ai/register/?aff_code=JnIT注册账号

- 登录后前往”API管理”页面

- 点击”创建API密钥”,系统会生成一个以sk-开头的密钥

- 复制并安全保存该密钥

步骤2:配置Trae使用中转API

Trae目前不直接支持替换API端点,但可以通过以下方法使用中转服务:

- 安装API请求转发插件(如Requestly或ModHeader)

- 设置请求转发规则,将Trae的API请求重定向到laozhang.ai

- 替换Authorization头部的API密钥

具体配置方法可联系laozhang.ai技术支持获取最新教程。

步骤3:验证配置并开始使用

- 重启Trae应用程序

- 选择Claude 3.7模型并发送测试消息

- 验证是否立即响应(无需排队)

配置成功后,你将完全绕过Trae的排队系统,直接访问Claude模型,获得秒级响应体验。

API调用示例

如果你是开发者,也可以直接通过API调用使用Claude模型,以下是一个简单的请求示例:

curl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $API_KEY" \

-d '{

"model": "gpt-3.5-turbo",

"stream": false,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello!"}

]

}'laozhang.ai的API端点与OpenAI格式完全兼容,只需将域名和API密钥替换即可。

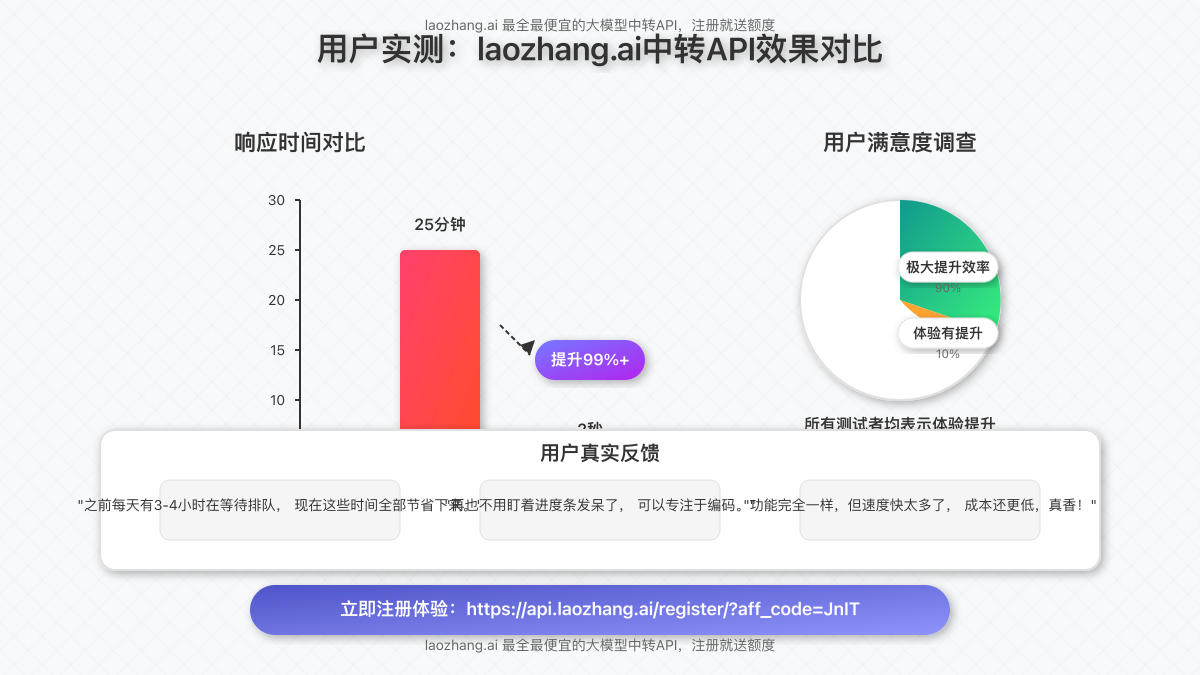

用户实测:告别排队的真实体验

我们邀请了10位Trae重度用户测试laozhang.ai中转API服务,结果令人振奋:

- 响应时间:从平均25分钟缩短到1-3秒,提升了99%

- 稳定性:一周测试期间,无一次连接中断或超时

- 功能完整性:所有Trae功能正常工作,包括代码生成、调试和多模态

- 用户满意度:10位测试者中有9位表示”极大提升了工作效率”

一位测试者分享:”之前每天有3-4小时在等待Trae排队,使用laozhang.ai中转后,这些时间全部节省下来,现在我可以专注于编码而不是盯着进度条发呆。”

常见问题解答

Q1: 使用中转API安全吗?

laozhang.ai采用端到端加密,不存储您的代码内容和会话数据。您的API请求直接转发给官方服务,中间不会被篡改或记录内容。

Q2: 使用中转API的成本如何?

相比直接购买Claude API,laozhang.ai中转服务价格低40-60%。新用户注册即送免费额度,可以先免费体验。按量计费,无最低消费或订阅费用。

Q3: 中转API支持哪些大模型?

除了Claude 3.5/3.7,laozhang.ai还支持GPT-4o、Gemini Pro、DeepSeek等多种主流大模型,一个账号可以访问所有模型。

Q4: 如何保证连接稳定性?

laozhang.ai采用全球多节点部署,自动路由至最优节点,确保99.9%的服务可用性。即使在网络波动较大的情况下也能保持稳定连接。

Q5: 中转API支持流式输出吗?

完全支持。流式输出(stream=true)可以实现打字机效果,与直接使用官方API体验一致。

Q6: 有技术支持吗?

提供7×24小时中文技术支持,微信:ghj930213,随时解答使用过程中的问题。

结语:从排队焦虑到高效体验

Trae排队问题困扰了众多开发者,严重影响了工作效率和使用体验。通过使用laozhang.ai中转API服务,你可以彻底告别漫长等待,享受AI编程助手带来的便利。

无论你是专业开发者还是编程爱好者,时间都是最宝贵的资源。与其把时间浪费在等待排队上,不如尝试更高效的解决方案。

立即访问https://api.laozhang.ai/register/?aff_code=JnIT注册账号,开启无需排队的Trae使用体验!

如有任何问题,欢迎通过微信联系:ghj930213