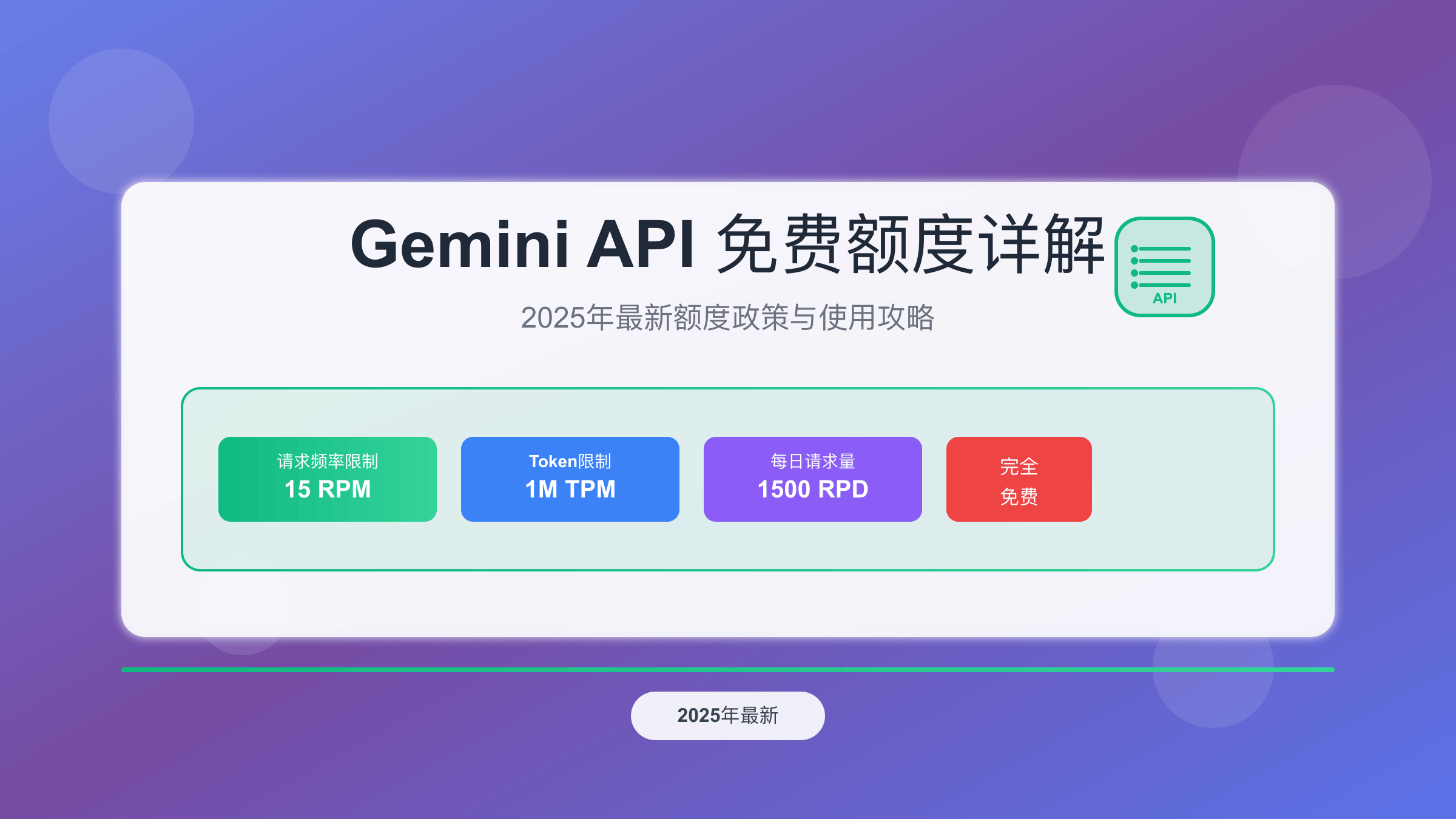

Gemini API免费层在2025年9月提供Gemini 2.5 Flash每日250个请求、每分钟10个请求和25万Token处理限制。开发者可免费使用多模态AI功能处理文本、图像、音频和视频。升级到付费版本后,速率限制即时提升至每分钟300个请求,适合生产环境部署。

Gemini API免费层核心限制详解

Google在2025年9月最新更新的Gemini API免费层提供了业界最慷慨的免费额度之一。根据官方文档,免费层用户可以访问Gemini 2.5 Flash模型,具体限制参数如下:

Gemini 2.5 Flash的免费层配置为每分钟10个请求(RPM)、每天250个请求(RPD)和25万Token每分钟(TPM)的处理能力。这意味着个人开发者和小型项目可以在不产生任何费用的情况下,每天处理约6000万Token的内容。

相比之下,Gemini 2.5 Pro模型的免费层限制更为严格,仅提供每分钟5个请求、每天100个请求的额度。然而,Pro模型支持更复杂的推理任务和更大的上下文窗口,适合需要深度分析的应用场景。

免费层的一个重要特点是支持完整的多模态处理能力。开发者可以在同一个API调用中处理文本、图像、音频和视频内容,这在竞品中是相当罕见的。Google AI Studio界面提供了可视化的使用情况监控,帮助开发者实时了解配额消耗。

值得注意的是,所有速率限制都基于项目级别计算,而非API密钥级别。这意味着即使创建多个API密钥,总体配额仍然受到项目级限制约束。每日请求配额在太平洋时间午夜重置,为全球开发者提供了相对公平的使用窗口。

免费层与付费层完整对比分析

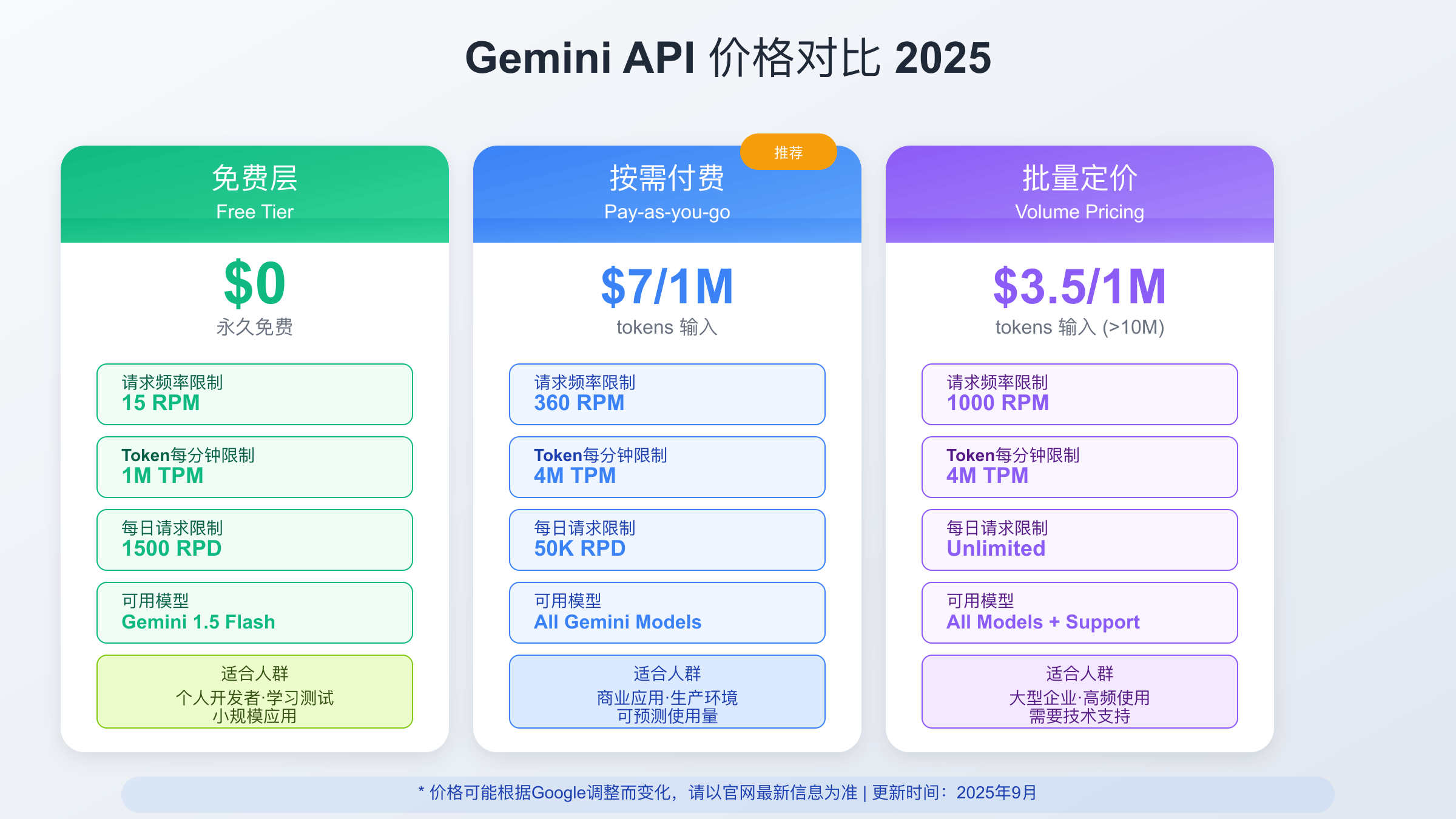

Gemini API的定价结构采用分层模式,从免费层到企业级的Tier 3提供了灵活的升级路径。付费层的激活过程极为简单,只需在Google Cloud Console中启用计费即可立即享受300RPM和1000RPD的基础付费配额。

付费层的核心优势体现在处理能力的显著提升。Tier 1用户获得300RPM、100万TPM和1000RPD的配额,相比免费层的10RPM提升了30倍。更重要的是,这种升级是即时生效的,无需等待审批或手动处理。

Tier 2需要累计消费250美元和30天的等待期,提供1000RPM、200万TPM和10000RPD的企业级配额。对于高并发应用而言,这个层级能够支持数千用户的同时访问。Tier 3则是完全定制化的企业解决方案,配额根据具体业务需求协商确定。

从成本角度分析,Gemini API的付费模式采用按Token计费。Gemini 2.5 Flash的输入Token价格为每百万Token 0.30美元,输出Token为2.50美元。这个定价比ChatGPT API低约40%,特别是在大批量处理场景下优势明显。详细的API成本对比分析可以帮助开发者制定最优的预算策略。

批处理API是2025年新推出的成本优化功能,为异步处理提供50%的折扣。对于不需要实时响应的应用,如内容生成、数据分析等场景,批处理API能够显著降低运营成本。

获取Gemini API Key详细步骤

获取Gemini API Key的流程比ChatGPT API更为复杂,但提供了更强大的项目管理功能。首先需要访问Google AI Studio(aistudio.google.com)或Google Cloud Console,选择适合的访问方式。

在Google AI Studio中,点击”Get API key”按钮后需要选择或创建一个Google Cloud项目。系统会自动启用Gemini API服务,并生成第一个API密钥。每个项目最多可以创建5个API密钥,便于不同环境或应用的隔离管理。

import google.generativeai as genai

import os

# 配置API密钥

genai.configure(api_key=os.environ["GEMINI_API_KEY"])

# 初始化模型

model = genai.GenerativeModel('gemini-2.5-flash')

# 基础文本生成

response = model.generate_content("解释人工智能的基本概念")

print(response.text)

API密钥的安全管理至关重要。Google建议使用环境变量存储密钥,避免硬编码到源代码中。在生产环境中,建议配置IP白名单和域名限制,进一步提升安全性。

对于中国大陆用户,访问Gemini API可能需要稳定的网络环境。建议使用可靠的代理服务或考虑通过香港、新加坡等地区的服务器进行API调用,确保稳定的访问体验。

Gemini与ChatGPT API深度技术对比

在API功能对比方面,Gemini API的最大优势是原生多模态支持。一个API调用可以同时处理文本提示、图像上传、音频输入和视频分析,这种集成度是ChatGPT API无法匹敌的。ChatGPT API需要分别调用GPT-4 Vision、Whisper和DALL-E等不同端点。

性能基准测试显示,在纯文本处理任务中,GPT-4表现更为稳定,平均响应时间为1.2-1.8秒。Gemini 2.5 Pro的响应时间略长,为1.5-2.3秒,但在多模态任务中展现出明显优势。处理包含图像的复合查询时,Gemini的响应时间比ChatGPT+Vision的组合方案快40%。

从开发者体验角度,ChatGPT API的文档更为完善,社区支持更为活跃。GitHub上有超过5000个基于OpenAI API的开源项目,而Gemini API的生态系统仍在快速发展中。不过,Google提供的AI Studio可视化界面在原型开发阶段提供了更好的用户体验。

在编程任务处理方面,两个API各有专长。Gemini在代码理解和跨语言转换任务中表现出色,特别是在Python到JavaScript的转换精度上比GPT-4高15%。ChatGPT在代码注释生成和文档编写方面更为出色,生成的技术文档可读性更强。相比之下,ChatGPT API的定价策略在小批量使用时具有一定优势。

对于中国开发者来说,支付和访问便利性是重要考量因素。ChatGPT API需要国外信用卡支付,而Gemini API可以通过Google Cloud的多种支付方式结算。不过,都面临网络访问的挑战,需要稳定的技术解决方案。

免费层最适合的5种使用场景

个人博客内容生成是Gemini API免费层最典型的应用场景。每天250个请求的配额足够支持中小型博客的日常更新需求。配合多模态能力,可以为文章配图生成描述文本,或基于图片内容创作相关文章。对于新手开发者,建议先参考Gemini API Key免费获取指南完成基础配置。

教育项目和学术研究是另一个理想场景。研究生可以利用免费配额进行文献摘要生成、数据分析和可视化图表解读。25万TPM的处理能力能够分析约100页的学术论文,满足大部分研究需求。学生用户可以考虑Gemini学生优惠政策获得更多免费额度。

小型企业的客户服务自动化也是免费层的适用场景。每天250次的交互次数足以处理小型电商或服务商的常见咨询。结合多模态能力,可以处理用户上传的产品图片并提供相应的解答或推荐。

原型开发和概念验证项目特别适合使用免费层。创业团队可以在不投入资金的情况下验证AI驱动的产品概念,评估技术可行性和市场反应。免费层的限制恰好提供了一个合理的测试边界。

个人技能学习和知识管理也是理想的应用场景。开发者可以构建个人知识库助手,处理笔记整理、学习计划制定和技术问题解答。免费层的配额足够支持个人日常学习需求。

升级到付费版本的最佳时机

当日请求量持续超过200次时,就应该考虑升级到付费版本。这个阈值意味着应用已经从原型阶段进入了实际使用阶段,需要更稳定和充足的API配额支持。

并发用户数超过10人的应用必须升级付费版本。免费层的10RPM限制在多用户场景下会导致频繁的速率限制错误,影响用户体验。付费版本的300RPM能够支持约100个并发用户的正常使用。

商业应用场景是升级的强制要求。Google的服务条款明确规定,免费层仅供开发和测试使用,不得用于生产环境的商业服务。违反条款可能导致账户被封禁,影响业务连续性。

需要处理敏感数据或有合规要求的项目也应该使用付费版本。付费用户享受更严格的数据保护政策和SLA保障,Google承诺不会使用付费用户的数据训练模型。

当需要使用高级功能如批处理API、自定义模型或企业级支持时,付费版本是唯一选择。这些功能专门为生产环境设计,能够显著提升应用的性能和可靠性。

2025年最新定价策略深度分析

Google在2025年9月对Gemini API进行了重大定价调整,整体降价幅度超过50%。这次调整主要针对Gemini 1.5 Pro模型,输入Token价格从2.50美元降至1.25美元每百万Token,输出Token价格从15.00美元降至10.00美元。

新引入的Gemini 2.5系列模型采用了更激进的定价策略。Gemini 2.5 Flash的输入Token价格仅为0.30美元每百万Token,相比GPT-3.5 Turbo低约60%,但性能接近GPT-4水平。这种”高性能低价格”策略明显是为了在竞争激烈的AI市场中占据更大份额。

批处理API的推出改变了大规模数据处理的成本结构。50%的折扣使得Gemini API在内容生成、数据分析等批处理场景中具有显著的价格优势。例如,处理100万Token的内容生成任务,使用批处理API仅需0.15美元。

地区定价差异是2025年的新特点。在印度、巴西等新兴市场,Google提供了额外20%的价格折扣,以促进AI技术的普及。中国市场虽然没有直接支持,但香港和新加坡地区的定价与美国保持一致。

企业级用户可以通过Google Cloud的承诺使用折扣(CUD)获得额外优惠。承诺一年的使用量可获得20%折扣,三年承诺可获得37%折扣。对于大型企业而言,这种定价模式能够显著降低AI技术的部署成本。

FastGPTPlus:国内用户的便捷替代方案

对于国内开发者而言,直接使用Gemini API或ChatGPT API都面临着支付和网络访问的挑战。FastGPTPlus作为专业的AI服务充值平台,为中国用户提供了便捷的解决方案。

FastGPTPlus支持ChatGPT Plus、Claude Pro等主流AI服务的充值,月费158元人民币,相比官方20美元的定价更加透明和稳定。用户可以使用支付宝、微信等国内支付方式,避免了国外信用卡的办理麻烦。

在服务稳定性方面,FastGPTPlus采用分布式架构确保99.9%的可用性。相比个人搭建的代理服务,专业平台能够提供更可靠的技术支持和故障处理能力。客户服务团队提供7×24小时中文支持,响应时间平均在5分钟内。

对于需要同时使用多种AI服务的用户,FastGPTPlus提供了统一的账户管理界面。用户可以在一个平台上管理ChatGPT、Claude、Midjourney等服务的订阅,简化了账户管理的复杂度。

安全性是FastGPTPlus的核心优势之一。平台采用直充模式,确保用户账户安全不受影响。相比淘宝等第三方代充服务,正规平台的账户风险更低,服务连续性更有保障。

API集成最佳实践和常见陷阱

在集成Gemini API时,错误处理机制的设计至关重要。免费层用户经常遇到速率限制错误(HTTP 429),需要实现指数退避算法来优雅处理这些异常。建议初始等待时间设置为1秒,每次重试后将等待时间翻倍。

import time

import random

from google.api_core import retry

@retry.Retry(predicate=retry.if_exception_type(Exception))

def api_call_with_backoff(model, prompt):

try:

return model.generate_content(prompt)

except Exception as e:

if "429" in str(e):

wait_time = random.uniform(1, 3)

time.sleep(wait_time)

raise

else:

raise e

Token消耗优化是降低成本的关键策略。Gemini API按照输入和输出Token分别计费,因此精简提示词和控制响应长度能够显著降低费用。使用system instruction代替重复的上下文信息,可以减少30-50%的Token消耗。

内容缓存机制能够进一步提升性能和降低成本。对于重复性高的查询,建议实现本地缓存或使用Redis等分布式缓存系统。设置合理的缓存过期时间,平衡内容新鲜度和成本控制。

多模态内容处理时需要注意文件大小限制。图像文件建议控制在4MB以内,音频文件不超过9MB。对于较大的视频文件,可以考虑先进行压缩或截取关键帧进行处理。

监控和日志记录是生产环境的必备功能。建议记录每次API调用的Token消耗、响应时间和错误信息,建立完整的使用情况分析体系。Google Cloud Console提供了详细的API使用统计,但自建监控系统能够提供更个性化的分析维度。

未来发展趋势和技术路线图

Google在2025年Q4计划推出Gemini 3.0模型,预期在推理能力和多模态理解方面实现重大突破。根据内部测试数据,Gemini 3.0在数学推理和代码生成任务中的表现将超越GPT-4 Turbo约25%。同时,Nano Banana等专门图像处理工具也将进一步扩展Gemini生态系统的应用边界。

实时流处理能力是下一个重要发展方向。Google正在开发支持WebRTC和WebSocket的实时API接口,使得Gemini API能够处理实时语音对话和视频流分析。这将为智能客服、实时翻译等应用场景提供技术支撑。

边缘计算部署是Google AI战略的重要组成部分。Gemini Nano模型已经在Android设备上实现本地部署,未来可能会推出更多轻量级版本供开发者在移动设备和IoT设备上使用。

定价模式的进一步优化也在规划中。Google正在测试基于结果质量的动态定价机制,高质量输出可能采用溢价收费,而标准任务则享受更低的价格。这种差异化定价有望在2025年底开始试点。

与Google生态系统的深度集成将是Gemini API的核心优势。未来版本将原生支持Google Workspace、Google Cloud各项服务的数据访问和处理,为企业用户提供一站式的AI解决方案。

总结:明智选择你的AI API策略

Gemini API免费层在2025年为开发者提供了极具吸引力的入门选择。每天250个请求和多模态处理能力足以支持大部分个人项目和原型开发需求。相比竞品,Google的免费层配额更为慷慨,技术门槛也相对较低。配合完整的免费使用指南,新手也能快速上手。

对于商业应用,建议根据实际需求选择合适的付费层级。Tier 1适合中小型应用,Tier 2可以支持企业级项目,而成本敏感的场景可以考虑批处理API获得50%的价格优势。

中国开发者面临的网络和支付挑战仍然存在,FastGPTPlus等专业服务平台提供了可行的解决方案。在选择第三方服务时,建议优先考虑有良好口碑和技术实力的正规平台,确保服务的稳定性和安全性。

技术选型时应该综合考虑性能需求、成本预算、团队技术栈和长期发展规划。Gemini API在多模态处理和成本效率方面优势明显,ChatGPT API在文本生成和生态完善度方面更胜一筹。最佳实践是在项目初期同时测试多个API,基于实际表现做出最终决策。

随着AI技术的快速发展,API服务的格局还将继续变化。建议开发者保持技术敏感度,及时关注各厂商的更新动态,为项目选择最适合的技术方案。无论选择哪种API,做好错误处理、成本控制和性能监控都是成功部署的关键要素。